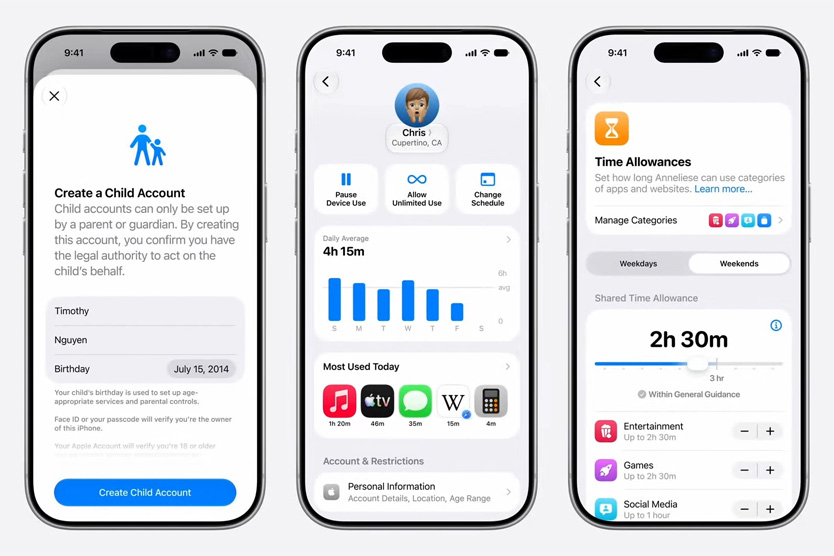

Широкополосный доступ в интернет в России: чем занимается компания «Бюро 1440»

Российская аэрокосмическая компания «Бюро 1440» потеряла один из 16 первых серийных спутников. В комментарии «Коммерсанту» ее представители заявили, что на данный момент на низкой околоземной орбите находится шесть экспериментальных аппаратов «Рассвет-1» и «Рассвет-2», а также 15 спутников первого запуска — их отправили на орбиту в марте 2026 года. Тогда этот этап называли «переходом от экспериментов к созданию сервиса связи» с глобальным покрытием.

Что именно произошло с одним из спутников, не уточняется. Об этом инциденте еще 6 июня писал журналист и основатель сайта RussianSpaceWeb Анатолий Зак: он предположил, что аппарат, «вероятно, сгорел в атмосфере». Официально эта информация не подтверждена.

Фото: Telegram-канал «БЮРО 1440»

Частную компанию «Бюро 1440» основали в 2020 году. Ее название отсылает к числу оборотов вокруг Земли, сделанных «Спутником-1» — первым в мире искусственным спутником планеты, который СССР запустил в 1957 году. Свою цель команда «Бюро 1440» сформулировала так: создать низкоорбитальную спутниковую группировку с глобальным покрытием и надежным сервисом широкополосной передачи данных. Проект финансируется в рамках нацпроекта «Экономика данных»: до 2030 года на его реализацию направят 102,8 млрд рублей из федерального бюджета — в дополнение к 329 млрд рублей из собственных средств компании.

Начало коммерческой эксплуатации сервиса намечено на 2027 год. К этому моменту количество спутников на орбите должно составить около 250. К слову, аппараты группировки «Рассвет» — собственная разработка «Бюро 1440», отмечает Naked Science. Они оснащены аппаратурой спутниковой связи на основе

Мы дадим свой ответ Starlink (Глобальная система спутниковой связи, созданная SpaceX Илона Маска. — Прим. ред.) с проектом «Рассвет» «Бюро 1440». У нас также появится низкоорбитальная широкополосная связь.

Дмитрий Бакановглава Роскосмоса

В планах «Бюро 1440» — к 2035 году запустить на орбиту более 900 спутников и оказывать услуги широкополосного доступа в интернет в 75 странах мира. Более того, аэрокосмическая компания уже сотрудничает с бизнесом. Так, в январе 2025-го она заключила договор с «Мегафоном» и собирается обеспечить связью 500 станций оператора, к которым невозможно или нецелесообразно тянуть наземные линии. Аналогичный контракт подписан с «Билайном». А на ПМЭФ – 2026 «Бюро 1440» и Федеральная пассажирская компания согласовали план внедрения спутниковой связи в поездах дальнего следования. Доступ к высокоскоростному интернету появится у пассажиров порядка 400 составов.

С какой скоростью Starlink Илона Маска и другие компании выводят спутники на орбиту

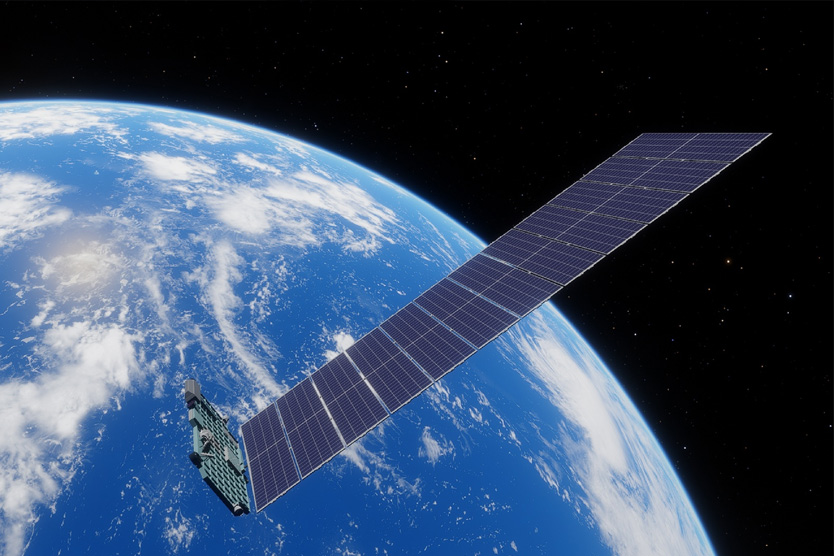

На сегодняшний день на глобальном рынке спутникового интернета есть очевидный лидер — Starlink Илона Маска. По последним подсчетам, на орбите находится более 10,4 тыс. спутников компании. Они обеспечивают высокоскоростным интернетом уже 10,3 млн подписчиков по всему миру. Согласно прогнозам экспертов, к концу 2026-го число клиентов вырастет до 15 млн, а к 2036-му — до 300 млн.

Фото: Zuma / TASS

Starlink уже предоставляет доступ в интернет воздушным и морским судам, обеспечивает связь в труднодоступных регионах и продвигает военную версию сервиса под названием Starshield. Из документов, раскрытых SpaceX накануне выхода на биржу, следует, что система спутниковой связи — главная опора бизнеса аэрокосмического гиганта. Дело в том, что это единственный прибыльный актив компании: в первые 3 месяца 2026-го только сегмент Starlink работал в плюс (операционная прибыль составила $1,19 млрд).

Starlink — это потенциально интернет для всей планеты. Сегодня миллионы людей не имеют доступа к интернету. Это значит, что к середине следующего десятилетия Starlink может обеспечить себе годовой доход в размере примерно $500 млрд.

Рон Барон

инвестор, основатель компании по управлению капиталом Baron Capital

Изначально Федеральная комиссия по связи США (FCC) предоставила SpaceX разрешение на запуск 12 тыс. спутников Starlink. Но компания подала документы с запросом на размещение еще 30 тыс. космических аппаратов. Такие масштабы уже беспокоят астрономов (они говорят, что яркие объекты на орбите мешают наблюдениям), экспертов по безопасности космических полетов (они считают Starlink риском столкновений на орбите №1) и экологов (количество металла, которое сгорает в атмосфере Земли при сходе старых спутников с орбиты, может спровоцировать непредсказуемые изменения климата).

Вытеснить Starlink с доминирующего положения непросто: SpaceX производит по меньшей мере четыре спутника в день, а ракета Falcon 9 может взять на борт более 25 таких аппаратов одновременно. К тому же сами пользователи называют систему связи «невероятной» и рассказывают, как спокойно смотрят YouTube и слушают подкасты во время перелетов. Поэтому конкурентов у Starlink практически нет. Ближайшим соперником чаще всего называют британскую корпорацию OneWeb, которая с 2022 года входит в состав французского спутникового оператора Eutelsat. Но компания вывела на орбиту лишь около 650 аппаратов — и те считаются довольно устаревшими: интернет-сервис OneWeb работает медленнее Starlink.

Чтобы противостоять американскому конкуренту, франко-германская Airbus, итальянская Leonardo и французская Thales объявили об объединении своих аэрокосмических подразделений — крупнейших в Европе. Они вели переговоры больше года и стояли перед выбором: совместить усилия или быть вытесненными с рынка компанией Илона Маска. Теперь компаниям предстоит согласовать условия сделки с правительствами, а затем заняться «укреплением стратегической автономии Европы в космосе». Доминированием SpaceX обеспокоены и в Китае: несколько компаний из Поднебесной уже работают над созданием системы высокоскоростной защищенной связи. Крупнейшая из них вывела 90 спутников на орбиту, но пока предоставляет свои услуги только в Шанхае.

Фото обложки: Telegram-канал «БЮРО 1440»