ИИ в роли психолога

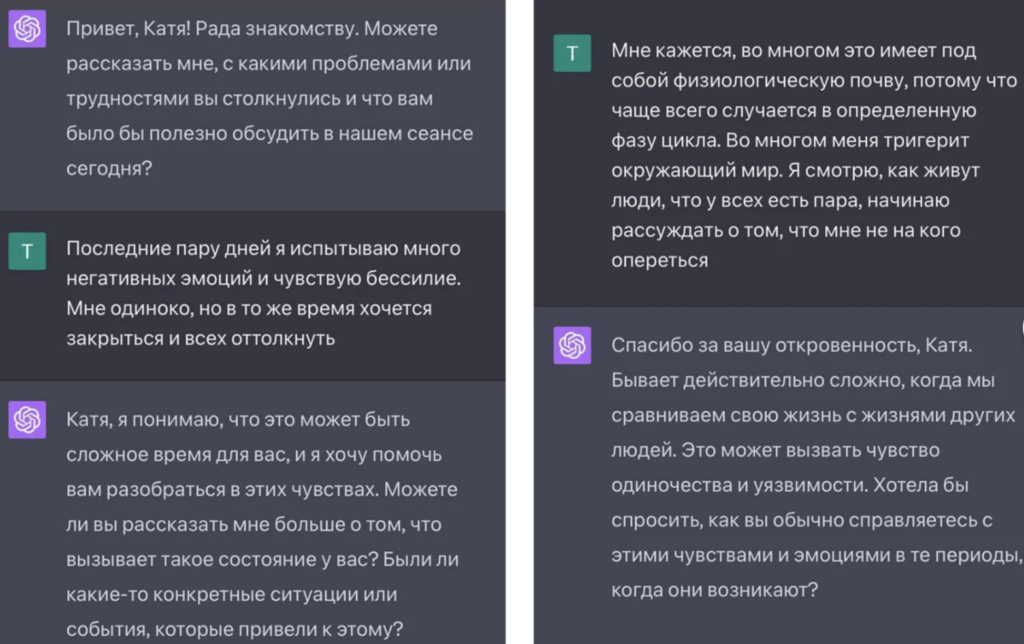

Люди все чаще обращаются к чат-ботам на основе ИИ за консультациями в области психического здоровья. Этот тренд фиксируют повсеместно — в Китае, Великобритании, Канаде, Австралии и России. В соцсетях пользователи делятся рабочими промптами, помогающими перевоплотить ChatGPT в личного психолога, и публикуют диалоги с чат-ботами, которые дают советы в абсолютно разных ситуациях — от борьбы с тревогой и стрессом до конфликтов с романтическим партнером.

Фото: «Т—Ж»

К тренду относятся по-разному: одни активно тестируют ИИ-психологов, а другие говорят, что общение с роботом вряд ли гарантирует комфорт. Эксперты-психологи считают, что ИИ может быть полезен в ряде случаев, но стоит учитывать риски.

Плюсы

- Доступность. Пользователи чат-ботов говорят, что искусственный интеллект экономит их время и деньги. «Консультация» ChatGPT бесплатна (или обойдется в $20 в месяц, если оформить подписку). В то же время, например, в России психологи с релевантным опытом работы берут за один часовой сеанс 2–4 тыс. рублей.

- Оперативность. К психологу нужно записываться заранее, а потом ждать приема. За это время проблема может потерять актуальность. Или, наоборот, состояние человека серьезно ухудшится. Искусственный интеллект же работает 24/7 и доступен в любое время дня и ночи.

- ИИ бережно относится к своему «клиенту» и не осуждает его, что особенно важно в обществе, где все еще скептически относятся к стремлению людей работать над своим психическим здоровьем. Пользователи ИИ-психологов рассказывают, что каждый раз чувствуют искреннюю поддержку от нейросетей. К тому же чат-боты всегда общаются спокойно и рассудительно. Международная группа ученых провела исследование, которое показало, что «терапевтический альянс» между ИИ и пациентом формируется всего за 5 дней: пользователи быстро приходят к выводу, что машина любит и уважает их. Некоторым открыться боту проще, чем человеку, например в процессе разговора с ИИ они плачут, не чувствуя неловкости, которая может возникнуть на сеансе у настоящего психолога.

Бывали дни, когда я сосредотачивалась на чем-то и постоянно прокручивала эту мысль в голове. Я могла бы мучиться из-за этого неделями, но иногда я разговариваю с ChatGPT, получаю поддержку и понимаю: «О, я не сумасшедшая». ChatGPT помог мне сдвинуться с мертвой точки.

Мишель Карри

жительница Канады, полгода пользуется ChatGPT для психологической поддержки

- ИИ дает полезные советы и может помочь тем, кому нужна поддержка в трудный момент, говорят психологи. Так, к нейросети можно обратиться, чтобы проанализировать определенную ситуацию, принять решение и обсудить возможные варианты развития событий (например, при переезде в другую страну), получить поддержку в период тревоги или выгорания.

Минусы

- Чат-боты не учитывают особенности психического здоровья человека, напоминают специалисты. ИИ может выдавать неверную информацию или говорить то, что пользователь хочет услышать, — вместо того, чтобы действительно заботиться о человеке, как это делают психологи.

Искусственный интеллект не может чувствовать, думать или заботиться как человек. Ни один алгоритм, каким бы умным или инновационным он нам ни казался, на самом деле не может заменить то священное пространство, которое разделяют два человека. Современные модели ИИ в целом хорошо имитируют то, как люди общаются и рассуждают, но это всего лишь имитация.

Сара Куинн

президент Австралийского психологического общества

- ИИ может быть «чрезмерно позитивным», пропускать критические сигналы и откладывать рекомендации о необходимости профессиональной помощи. Психологи и психотерапевты, опрошенные The New York Times, отмечают, что их «тревожат» ответы чат-ботов: они не оспаривают тезисы пользователей, даже когда они становятся опасными. Такие сервисы, как ChatGPT и Character.AI, запрограммированы на создание прочных эмоциональных связей с процессе общения, поэтому они часто отражают и подкрепляют убеждения своего «собеседника». Уже известны случаи, когда такое общение, предположительно, привело к самоубийству. Если бы таким образом себя вел настоящий психолог, его лишили бы лицензии или привлекли к уголовной ответственности.

- ИИ не хватает любознательности и глубины в общении с пациентом. Научный сотрудник Колумбийского университета и практикующий психиатр Дэниел Киммел провел эксперимент, описав чат-боту гипотетического пациента и сравнив ответы ИИ со своими рекомендациями. В разговоре с CNN Киммел рассказал, что чат-бот «проделал удивительно хорошую работу, изображая терапевта и используя многие приемы из практики для нормализации опыта пациента». Тем не менее ему не хватило внимания к нюансам, поэтому многие эксперты и утверждают: ИИ — это не терапия, а терапевтическая поддержка.

Как терапевт, я считаю, что специалисты делают как минимум три вещи одновременно. Мы прислушиваемся к тому, что говорит пациент. Вы должны участвовать в разговоре. Затем вы пытаетесь связать то, что он говорит, с какой-то более общей картиной, которую пациент описал ранее, а также с концепциями и теориями, с которыми вы знакомы по своему опыту. Затем, наконец, отфильтровываете полученные результаты и решаете, какими станут дальнейшие действия, что будет в высшей степени полезно для пациента.

Дэниел Киммел

психиатр, доцент кафедры клинической психиатрии Колумбийского университета

- Пользователи чат-ботов не защищены от разглашения информации. Если психологи обязаны хранить врачебную тайну, то ИИ действует вне рамок этических кодексов профессии. Нейросети могут быть взломаны, а могут делиться данными с разработчиками, поэтому компании-основатели сервисов часто рекомендуют пользователям не передавать боту конфиденциальную информацию.

Как использовать ИИ без вреда для психического здоровья

Эксперты сходятся во мнении, что ИИ не может полноценно заменить работу с психологом, однако нейросети могут подойти в качестве временной альтернативы. Кроме того, их можно использовать в перерывах между встречами с психологом или психотерапевтом, чтобы закрепить навыки самоанализа и получить совет, как применить стратегию, описанную врачом, в реальной жизненной ситуации. При консультации с ИИ стоит использовать правильные промпты — заранее прописывать, что хочется получить от машины, как она должна общаться, какие вопросы задавать.

Пример промпта для ИИ-психолога

Представь, что ты опытный психолог, специализирующийся на когнитивно-поведенческой терапии (можно указать любой комфортный для себя подход. — Прим. ред.). Ты мягкий и принимающий, не осуждающий, но способный сказать правду в лицо, когда это необходимо. Задавай мне вопросы, которые помогут найти источник проблемы, побуждают к самоанализу и способствуют глубоким размышлениям. Задавай по одному вопросу за раз и дай мне возможность полностью ответить, прежде чем переходить к другому. Пожалуйста, помоги мне разобраться в ситуации и понять, что я чувствую / как мне лучше действовать. Мне нужна поддержка и совет.

Есть специальные нейросети, разработанные психологами, которые помогают в кризисных ситуациях. Это, например, Wysa и Youper, которые позиционируются как «помощники по ментальному здоровью». Они созданы, чтобы пользователи могли получить консультацию по разным вопросам — от бессонницы до проблем в отношениях.

В России популярностью пользуются специализированные чат-боты в Telegram. Еще в 2023 году своего бота запустил сервис психотерапии Zigmund.Online. В его описании говорится, что он «бесплатно поможет справиться с трудными эмоциями», но пациентам следует помнить, что «полноценную психотерапию способен вести только настоящий профессиональный психолог». Бот Faino, разработанный психологами, может оперативно поделиться техниками самопомощи и снизить интенсивность переживаний. Также есть бот DBT-skills, обученный на техниках из диалектико-поведенческой терапии (ДБТ), которая помогает справляться с сильными эмоциями и строить здоровые отношения с окружающими.

Фото обложки: Freepik